Page 288 - 《软件学报》2025年第4期

P. 288

1694 软件学报 2025 年第 36 卷第 4 期

因此, 在非理想的环境下, 传统方法难以取得较好的重建效果. 随着计算机视觉技术的发展和算力的提升, 深

度学习方法开始着手解决以上问题. 与传统方法相比, 基于深度学习的方法具有以下优势.

(1) 重建耗时短. 基于深度学习的方法利用强大的特征提取能力避免了繁琐的特征匹配和视差计算过程, 能够

提高重建的效率.

(2) 对场景的鲁棒性强. 基于深度学习的方法通过学习更丰富的特征表示 [6] 和利用上下文信息能够增强对非

朗伯场景的鲁棒性.

(3) 泛化性强. 基于深度学习的方法能够提取更深层次的特征, 学习利用不同场景的特征对度量优化调整, 减

少了手工设计度量方法的局限性.

(4) 能够实现大规模场景的重建. 基于深度学习的方法减少对特征点和视差信息的存储需求降低了内存消耗,

能够更好地应对大规模场景的重建需求.

最初, 有研究者 [8−13] 使用深度学习模型结合传统 MVS 方法中的部分模块, 实现部分集成以提高单个模块的性

能. 在这个阶段, 仍然存在需要手工设计的处理步骤. 目前基于深度学习的多视图立体视觉 (MVS) 网络主要分为

3 类: 基于深度图、基于体素和基于辐射场. 这些方法避免了繁琐的手工设计, 实现了端到端的学习. 这 3 种方法

(Khot等人 ) (Dai等人 )

都是根据一组图像及其相机参数, 通过端到端网络结构获得三维模型. 其中, 基于深度图的方法需要先获得深度

图, 然后通过融合深度图得到三维点云模型, 基于体素的方法可以直接获得由体素表示的三维模型, 而基于辐射场

的方法则通过距离函数或高斯函数的表示三维表面重建结果.

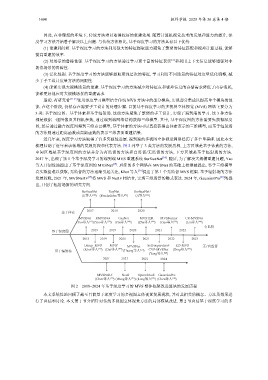

近几年来, 深度学习方法取得了许多突破性进展. 端到端的多视图立体视觉网络经历了多个里程碑. 因此本文

梳理归纳了近年来该领域的发展历程和代表方法. 图 2 列举了 3 类方法的发展历程, 上方区域是基于体素的方法,

中间区域是基于深度图的方法并分为有监督的方法和自监督/无监督的方法, 下方区域是基于辐射场的方法.

2017 年, 出现了第 1 个基于深度学习的端到端 MVS 重建系统 SurfaceNet [14] . 随后, 为了解决大规模重建问题, Yao

等人开创性地提出了基于深度图的 MVSNet [15] . 后续的多个网络在 MVSNet 的基础上相继被提出. 鉴于三维模型

真实数据难以获取, 无监督的方法逐渐引起关注, Khot 等人 [16] 提出了第 1 个无监督 MVS 框架. 基于辐射场的方法

发展较晚, 2021 年, MVSNeRF [17] 将 MVS 和 NeRF 相结合, 实现三维场景的隐式表达. 2024 年, GaussianPro [18] 的提

出, 开创了辐射场新的研究方向.

SurfaceNet RayNet SurfaceNet+

(Ji等人 ) (Paschalidou等人 ) (Ji等人 )

[21]

[22]

[14]

基于体素 2017 2018 2020

MVSNet RMVSNet GasNet MVSTER MVSFormer CR-MVSNet

[48]

[44]

[15]

[46]

(Yao等人 )(Yao等人 ) (Gu等人 ) (Zhu等人 ) (Gao等人 ) (Liu等人 )

[52]

[38]

有监督

基于深度图 2019 2019 2020 2021 2022

2018 2019 2020 2021 2022 2023

Unsup_MVS MVS 2 M VSNet Self-supervised- KD-MVS 无/自监督

3

[66]

[16] [59] CVP-MVSNet (Ding等人 )

基于辐射场 (Huang等人 )

[61]

[62]

(Yang等人 )

2021 2021 2022 2024

MVSNeRF NeuS SparseNeuS GaussianPro

[18]

[74]

[17]

(Chen等人 ) (Wang等人 ) (Long等人 ) (Chen等人 )

[71]

图 2 2018–2024 年基于深度学习的 MVS 整体框架改进算法的发展历程

本文系统性地回顾了截至目前基于深度学习的多视图立体视觉发展现状, 并对其相关的概念、方法及效果进

行了总结和讨论. 本文第 1 节介绍针对传统多视图立体视觉方法的局部模块改进. 第 2 节总结基于深度学习的多