Page 464 - 《软件学报》2024年第6期

P. 464

3040 软件学报 2024 年第 35 卷第 6 期

Train images Labeled images

AGR-Net

Graph

Search

Test images Coarse segmentation results Fine segmentation results

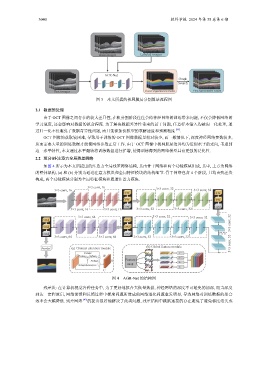

图 3 本文所提的视网膜层分割算法流程图

2.1 数据预处理

由于 OCT 图像之间存在的较大差异性, 在粗分割阶段往往会给神经网络的训练带来问题, 不仅会降低网络的

学习速度, 还会影响对数据的拟合程度. 为了解决数据差异性带来的若干问题, 任意样本输入均被归一化处理, 通

过归一化不仅避免了数据奇异性问题, 而且能够加快模型的求解速度和预测精度 [44] .

OCT 图像的获取较困难, 导致用于训练的 OCT 图像数据量相对较少, 而一般情况下, 深度神经网络参数较多,

从而需要大量的训练数据才能使网络参数正常工作. 由于 OCT 图像中视网膜层边界均为近似水平的走向, 考虑到

这一水平特性, 本文通过水平翻转将训练数据进行扩增, 使得训练得到的网络模型具有更强的泛化性.

2.2 粗分割-注意力全局残差网络

如图 4 所示为本文所提出的注意力全局残差网络结构, 其由骨干网络和两个功能模块组成, 其中, 上方为网络

的整体架构, (a) 和 (b) 分别为通道注意力模块和全局特征模块的结构细节. 骨干网络包含 4 个阶段, 且均由残差块

构成, 两个功能模块分别为全局特征模块和通道注意力模块.

3×3 conv, 16 Feature

3×3 conv, 32

3×3 conv, 16 3×3 conv, 32

GFM GFM

GFM GFM

CAM CAM

3×3 conv, 16 3×3 conv, 16 3×3 conv, 32 3×3 conv, 32

3×3 conv, 32

3×3 conv, 64 3×3 conv, 32 3×3 conv, 32

GFM GFM

GFM GFM

CAM CAM

3×3 conv, 32

3×3 conv, 64 3×3 conv, 64 3×3 conv, 32 3×3 conv, 32

(b) Global feature module

Decoder (a) Channel attention module

Reshape GRU

Reshape Softmax W

GRU

Reshape H GRU

map

Reshape&transpose

GRU

C

图 4 AGR-Net 的结构图

残差块: 在计算机视觉各种任务中, 为了更好地拟合大批量数据, 神经网络的深度不可避免的加深, 而当深度

到达一定程度后, 网络前馈和反馈过程中梯度问题所造成的网络退化问题愈发明显, 导致网络对训练数据的拟合

效率会大幅降低. 残差网络 [45] 的提出很好地解决了此类问题, 残差结构中跳跃连接的存在避免了避免梯度消失或