Page 169 - 《软件学报》2021年第12期

P. 169

韩鹏宇 等:案件要素句子关联图卷积的案件舆情摘要方法 3833

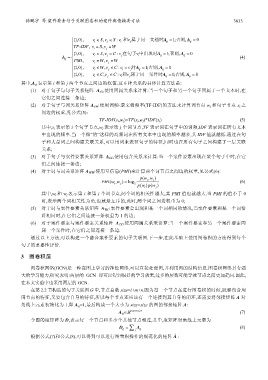

⎧ {1,0}, v ∈ i , S v ∈ j S : i v 和 属于同一文档时A ij = 1;否则 A ij = 0

,

v

j

⎪

⎪ TF -IDF v ∈ , i , S v ∈ j W

⎪ ⎪ {1,0}, v ∈ , S v ∈ C : v 在句子 v中出现时A = 1;否则 A = 0

,

A = ⎨ i j j i ij ij (4)

ij

⎪ PMI , v ∈ i W ,v ∈ j W

⎪ {1,0}, v ∈ W ,v ∈ C : v = v =时 1;否A , A = 则 0

⎪ i j i j ij ij

,

v

⎪ ⎩ {1,0}, v ∈ , C v ∈ C : v 和 属于同一案件时A ij = 1;否则 A ij = 0

j

i

j

i

其中,A ij 表示第 i 和第 j 两个节点之间边的权值.这 6 种关系的具体计算方法是:

(1) 对于句子与句子关系矩阵 A SS ,使用同属关系来计算:当一个句子和另一个句子同属于一个文本时,在

它们之间连接一条边;

(2) 对于句子与词关系矩阵 A SW :使用词频-逆文档频率(TF-IDF)的方法来计算词节点 w j 和句子节点 s i 之

间边的权重,见公式(5):

TF-IDF(s i ,w j )=TF(s i ,w j )*IDF(s i ) (5)

其中,s i 表示第 i 个句子节点,w j 表示第 j 个词节点,TF 表示词在句子中的词频,IDF 表示词在所有文本

中出现的频率.当一个像“的”这样的高频词在所有文本中出现的频率越多,其 IDF 值就越低.通过在句

子和大量词之间构建关联关系,可以用词来表征句子的特征,同时也在所有句子之间构建了一层关联

关系;

(3) 对于句子与案件要素关系矩阵 A SC ,使用包含关系来计算:当一个案件要素出现在某个句子中时,在它

们之间连接一条边;

(4) 对于词与词关系矩阵 A WW :使用互信息(PMI)来计算两个词节点之间边的权重,见公式(6):

pw )

(,w

PMI (,ww = log 2 i j (6)

)

i

j

() (pw

pw i j )

其中,w i 和 w j 表示第 i 和第 j 个词节点,两个词的相关性越大,其 PMI 值也就越大.当 PMI 的值小于 0

时,表示两个词相关性为负,也就是互斥的,此时,两个词之间边权重为 0;

(5) 对于词与案件要素关系矩阵 A WC :案件要素会出现和某一个词相同的情况,当案件要素和某一个词恰

好相同时,在它们之间连接一条权重为 1 的边;

(6) 对于案件要素与案件要素关系矩阵 A CC ,使用同属关系来计算:当一个案件要素和另一个案件要素同

属一个案件时,在它们之间连接一条边.

通过以上方法,可以构建一个融合案件要素的句子关联图.下一步,在此基础上使用图卷积的方法得到每个

句子的重要性评价.

3 图卷积层

图卷积网络(GCN)是一种在图上学习的神经网络,可以直接处理图,并利用图的结构信息.图卷积网络具有强

大的学习能力,研究表明:两层的 GCN 即可以得到很好的学习效果,过多的层数可能导致节点之间更加趋同.因此,

在本文实验中也采用两层的 GCN.

在第 2.2 节构造的句子关联图 G 中,节点总数 size=l+m+n.因为每一个节点在进行图卷积的时候,既要包含周

围节点的特征,又要包含自身的特征,所以每个节点还应该有一个连接到其自身的闭环,还需要将邻接矩阵 A 对

角线上元素初始化为 1,即 A ij =1,最后构成一个大小为 size×size 的图的邻接矩阵 A:

A ij ∈\ size×size (7)

令图的度矩阵为 D,表示每一个节点和多少个其他节点相连,其中,度矩阵对角线上元素为

=

D ij ∑ A ij (8)

j

根据公式(7)和公式(8),可以得到可以进行图卷积操作的规范化的矩阵 A :