Page 249 - 《软件学报》2021年第8期

P. 249

包希港 等:视觉问答研究综述 2531

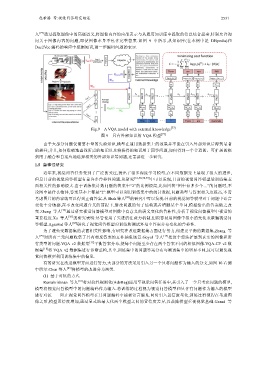

人 [77] 通过提取图像中的高级语义,将图像内容的内部表示与从通用知识库中提取的信息结合起来,特别允许询

问关于图像内容的问题,即使图像本身不包含完整答案.如图 9 中所示,从知识库(在本例中是 DBpedia)和

Doc2Vec 编码的响应中挖掘知识,进一步编码问题的表示.

Fig.9 A VQA model with external knowledge [77]

图 9 具有外部知识的 VQA 模型 [77]

由于大部分问题仅需要小量的先验知识,模型在通用数据集上的效果并不能在引入外部知识后得到显著

的提升;并且,如何准确地查找所需的知识以及将获得的知识用于回答问题,如何得到一个合适的、可扩展的框

架用于融合和自适应地选择相关的外部知识等问题,还需要进一步研究.

1.5 鲁棒性研究

近年来,视觉问答任务受到了广泛的关注,提出了很多深度学习模型,在不同数据集上展现了很大的进步,

但是目前的视觉问答模型有着许多鲁棒性问题.从研究 [16,30,78,79] 中可以发现,目前的视觉问答模型受训练集表

面相关性的影响很大.由于训练集计数问题的答案中“2”的比例很高,比如回答“图中有多少个…”的问题时,不

论图中是什么物体,答案基本上都是“2”.模型可以利用训练集中的统计数据,问题类型与答案相关度很高,不需

考虑图片的内容就可以得到正确答案.从 Shah 等人 [80] 的研究中可以发现:目前的视觉问答模型对于问题中语言

变化十分敏感,在不改变问题含义的前提下,修改问题的句子结构或者增删某个单词,模型给出的答案随之改

变.Zhang 等人 [79] 通过研究视觉问答模型对图像中有意义的语义变化的鲁棒性,分析了视觉问答模型中视觉的

重要程度.Xu 等人 [81] 的研究表明:尽管使用了先进的注意力机制,但很容易用图像中很小的变化来欺骗视觉问

答模型.Agrawal 等人 [82] 研究了视觉问答模型对训练和测试环境中答案分布变化的鲁棒性.

为了避免受数据集的表面相关性影响,有研究在改进数据集方面进行努力,创建更平衡的数据集.Zhang 等

人 [79] 对所有二元问题收集了具有相反答案的互补抽象场景.Goyal 等人 [17] 把这个想法扩展到真实的图像和所

有类型的问题.VQA v2 数据集 [17] 平衡答案分布,使每个问题至少存在两个答案不同的相似图像.VQA-CP v2 数

据集 [18] 将 VQA v2 数据集进行诊断重构,其中,训练集中的问题答案分布与测试集中的明显不同,这可以避免视

觉问答模型利用训练集中的偏见.

有的研究在改进模型方面进行努力,大部分的方法采用引入另一个只将问题作为输入的分支,如图 10 右侧

中所示.Chen 等人 [83] 将模型的改进分为两类.

(1) 基于对抗的方式

Ramakrishnan 等人 [18] 将对抗性规则化(AdvReg)应用至视觉问答任务中,其引入了一个只考虑问题的模型,

模型将视觉问答模型中的问题编码作为输入.将训练的过程视为视觉问答模型和只含有问题作为输入的模型

进行对抗——阻止视觉问答模型在其问题编码中捕捉语言偏见.同时引入置信度量化,训练过程使得在考虑图

像之后,模型置信度增加,通过显式地最大化两个模型之间的置信度差异,以鼓励模型重视视觉基础.Grand 等