Page 471 - 《软件学报》2025年第12期

P. 471

5852 软件学报 2025 年第 36 卷第 12 期

introduced, where branches alternately generate neighboring pixel fusion pseudo-labels, enhancing the diversity of supervision signals and

guiding branches toward different solutions. Experimental results demonstrate this method achieves excellent performance on the Pascal

VOC 2012 and Cityscapes validation datasets, with scores of 80.2% and 76.8%, outperforming the latest methods by 0.3% and 1.3%,

respectively.

Key words: computer vision; semantic segmentation; semi-supervised learning; co-training; pseudo-label

基于深度神经网络的语义分割任务已取得显著成功, 但这在很大程度上依赖于大量标注数据集 [1−4] . 由于语义

分割需要精确到像素级的标注, 标注人员必须手动标记每张图像中的数十万个像素. 这使得收集完全准确的标注

数据用于训练深度神经网络的成本极为高昂 [5−7] .

为减少模型对标注数据的依赖, 半监督语义分割提出利用大量未标注样本来增强网络在少量标注样本上的学

习能力, 提升模型的泛化性和通用性 [8−12] . 这一方法在标注成本高、数据量庞大且需要精细像素级标注的领域, 如

自动驾驶和医疗影像分析中, 具有广阔的应用前景 [13,14] .

显然, 半监督语义分割中有标签数据的数量远远少于无标签数据, 因此可用的标注信息非常有限. 如何充分利

用无标签数据来辅助有标签数据进行模型训练, 成为了一个关键问题. 一种直观的解决方案是为无标签数据生成

标签, 即通过模型推理生成伪标签, 以监督无标签数据的训练, 进而增加数据量 [15−17] . 然而, 在单分支网络中, 伪标

签是由模型自身的预测生成的, 如果伪标签出现错误, 模型会倾向于重复错误的预测, 导致错误信息在网络中不断

积累, 进而引发确认偏差 [18] .

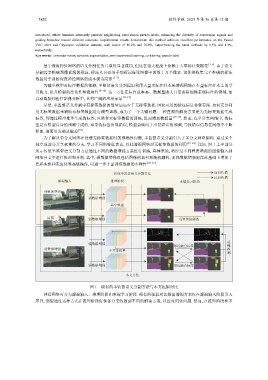

为了解决单分支网络在处理无标签数据时的准确性问题, 半监督语义分割引入了多分支网络架构. 通过多个

独立或部分共享权重的分支, 学习不同的特征表达, 以此增强网络对无标签数据的利用 [19−21] . 比如, 图 1 上半部分

所示传统半监督语义分割方法通过不同的数据增强方案进行训练, 具体来说, 将经过不同程度增强的图像输入到

网络分支中进行推理和分割. 其中, 弱数据增强仅包括图像的裁剪和随机翻转, 而强数据增强则在此基础上增加了

色彩变换和灰度化等高级操作, 以进一步丰富训练数据的多样性 [22−25] .

传统半监督语义分割方法 前向传播

反向传播

源端输入 推理阶段 末端学习阶段

强数据增强

强数据增强

共享权重

原图 弱数据增强 高置信度筛选

边

强数据增强

邻近融合标签 缘

弱数据增强 检

不共享权重

测

弱数据增强 邻近融合标签

本文方法

图 1 现有的半监督语义分割方法与本文框架对比

神经网络可分为源端输入、推理阶段和末端学习阶段. 现有的强弱对比数据增强方案仅在源端输入阶段引入

差异, 期望通过这种方式在推理阶段促使各分支收敛到不同的解决方案, 以应对同化问题. 然而, 在推理阶段和末