Page 465 - 《软件学报》2025年第9期

P. 465

4376 软件学报 2025 年第 36 卷第 9 期

将块 token 进行维度变换重塑为语义感知图, 然后将类与块注意力和语义感知图结合以获取位置线索. AFA [22] 从

ViT 的注意力机制中学习可靠的语义亲和力, 并利用学习到的语义亲和力去调节初始伪标签. ToCo [23] 设计了一个

patch token contrast 模块, 使用从中间层派生的伪标记关系来监督最终的 patch token, 其可以让语义区域更加对齐,

从而产生更准确的类激活图. 同时, ToCo 还提出了 class token contrast 模块, 从不确定区域中随机地取切片, 并最

小化局部与全局图像分别对应的类标记间的特征差异, 促进目标区域的表示一致性. 此外, 卷积神经网络与 ViT 结

合的工作也受到了越来越多的关注. TransCAM [24] 利用 ViT 分支产生的区域块间注意力来优化卷积神经网络分支

生成的类激活图.

与本文方法接近的一个工作是 MCTformer [14] , 它在类激活图优化阶段直接使用 ViT 生成的原始类与块间注

意力对初始类激活图进行优化. 然而据实验观察, 此时得到的原始类与块间注意力存在误差, 若直接对其进行使用

往往得不到理想的结果. 与其不同, 本文方法并不直接使用原始类与块间注意力来对初始类激活图进行优化, 而是

设计了一种语义调制策略, 利用区域块间注意力的语义上下文信息对类与块间注意力进行调制, 修正其误差, 使得

类与块间注意力的准确性显著提高. 之后, 综合利用调制后的类与块间注意力以及区域块间注意力来联合优化初

始类激活图, 得到能够准确覆盖较多前景目标区域的类激活图.

2 本文方法

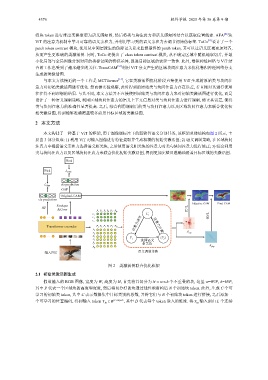

本文构建了一种基于 ViT 的框架, 用于图像级标注下的弱监督语义分割任务, 该框架总体结构如图 2 所示, 主

要由 3 部分组成: 1) 利用 ViT 对输入图像进行特征提取并生成粗糙的初始类激活图; 2) 语义调制策略, 在区域块间

注意力中根据语义亲和力选择语义相关块, 之后使用语义相关块的注意力对类与块间注意力进行修正; 3) 综合利用

类与块间注意力以及区域块间注意力来联合优化初始类激活图, 得到更加完整且准确地覆盖目标区域的类激活图.

Bird

Bird L patch

cls prediction

L class

GAP

Original-CAM

cls prediction

Adjustive-CAM Final-CAM

Reshape

AP

&Conv P 1 P 2 P 3 P 4 P ... 优化

5 P N

C 1 C c

注意力调节

... 优化

C 2

C c

Transformer enconder P 1 P 2 P 3 P 4 P 5 ... P N 注意力计算

P 1

A c2p

P 2

...

P 3 {P j }

P i

选择语义

P 4

... P 5 相关块

P N A p2p

输入图片 语义调制策略

图 2 类激活图联合优化框架

2.1 初始类激活图生成

假设输入的 RGB 图像, 宽度为 W, 高度为 H, 首先将其切分为 N = w×h 个不重叠的块, 这里 w=W/P, h=H/P,

其中 P 代表一个区域块的高度和宽度, 然后将切分好的块通过线性映射构造 N 个初始块 token. 此外, 生成 C 个可

学习的初始类 token, 其中 C 表示数据集中目标类别的总数, 并将它们与 N 个初始块 token 进行拼接, 之后添加一

个可学习的位置编码, 得到输入 token T in ∈ R (C+N)×D , 其中 D 代表每个 token 嵌入的维度. 将 T in 输入到由 L 个连续