Page 227 - 《软件学报》2025年第8期

P. 227

3650 软件学报 2025 年第 36 卷第 8 期

5.2 研究问题

为了全面评估基于因果时空语义抽象模型方法的有效性, 我们对以下两个问题进行了研究.

● 研究问题 1 (RQ1): 基于因果时空语义的抽象建模方法可否能够实现简洁性与准确性的有效平衡?

在复杂 ICPS 场景中, 尤其是状态和动作空间庞大的场景下, 构建简洁又准确的抽象 MDP 至关重要. 抽象

MDP 能够有效降低问题复杂性并提供决策依据. 然而, 抽象 MDP 往往伴随着一定程度的信息损失, 从而影响模型

的准确性和决策质量. 因此, RQ1 旨在探讨基于时空价值语义构建的抽象 MDP 模型在简化环境表示与保持决策

准确性之间寻求最佳平衡点的能力. 具体地, 本文将评估基于时空价值语义的抽象方法在简化 ICPS 环境复杂性的

同时, 对决策过程的影响程度以及可能导致的准确性变化.

● 研究问题 2 (RQ2): 基于因果时空语义的抽象 MDP 模型在决策性能上是否能接近或达到真实 MDP 的效

果? 此外, 抽象 MDP 与实际模型之间能否实现语义上的等价?

在实践中, 真实 MDP 模型会因状态空间庞大和系统结构复杂等限制, 影响模型的应用范围和效率. 因此, 如

果抽象 MDP 模型能在保持与真实 MDP 语义等价性的前提下, 展现出与真实 MDP 相似乃至更优的决策性能, 则

这种抽象 MDP 的实用价值和应用范围将大大提升. 因此, 研究抽象 MDP 模型是否能够达到与真实环境模型相似

的决策性能, 并探讨两者之间的语义等价性, 对于评估抽象 MDP 模型的有效性和实用性具有重要意义.

5.3 实验设置

本节详细描述了实验案例的各项实验设置、实验数据收集参数和抽象模型构建参数.

在数据收集阶段, 使用基于随机网络蒸馏 (random network distillation, RND) [31] 探索的好奇心驱动强化学习方

法生成 LKA、ACC 及 ICA 控制策略, 并对案例环境进行充分探索以收集系统数据. 具体而言, 在每个场景, 使用

基于好奇心驱动的强化学习控制器仿真 1 000 次, 从中收集经验. 然后, 将收集到的经验以 8:2 的比例划分为建模

集和验证集. 前者用于构建抽象模型, 后者用于分析抽象模型和具体模型之间的语义误差. 针对 3 个案例中涉及的

深度学习网络的超参数设定如表 1 所示, 系统的 actor 学习率和 critic 学习率分别为 1.0×10 、 1.0×10 , 折扣因子 γ

−3

−4

设定为 0.95, 策略延迟更新步长设定为 2. 此外, LKA 和 ACC 的好奇心网络损失比例为 2, ICA 的好奇心网络损失

比例为 0.1. LKA 奖励设定为 reward = 1−y −θ yaw −outOfLane cost ; ACC 奖励设定为 reward = 0.05×v x −collision cost −

2

2

outOfLane cost ; ICA 奖励设定为 reward =speed reward +arrived reward −collision cost . 当智能体的速度在设定范围内且在规

定时间内抵达目的地时, 会给予奖励. 当智能体偏离车道中心线、与车道方向的夹角变大或发生碰撞时, 则会进行

惩罚.

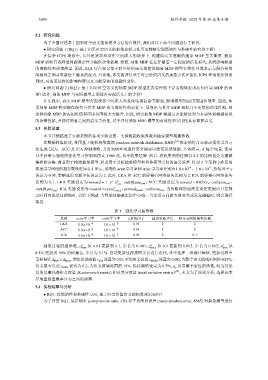

表 1 强化学习超参数

系统 actor学习率 critic学习率 γ折扣因子 延迟更新步长 好奇心网络损失比例

LKA 1.0×10 −4 1.0×10 −3 0.95 2 2

ACC 1.0×10 −4 1.0×10 −3 0.95 2 2

ICA 1.0×10 −4 1.0×10 −3 0.95 2 0.1

抽象过程的超参数, d j 从 0.01 更新到 0.1, 步长为 0.001; d j 从 0.1 更新到 0.005, 步长为 0.005; n j 从

MIN MAX MIN

0.1% 更新到 10% 的值集合, 步长为 0.1%. 自动更新过程按照步长进行迭代, 从中选择一组最佳阈值, 更新过程中

需要保证 d MIN ⩽ d MAX . 期望误差阈值 e pred 设置为 0.05. 平均语义误差 e MEAN 设置为 0.005, 为整个语义值域范围的 0.25%,

e MAX 设置为 0.2, 为语义值域范围的 10%. 优化阈值设定为 0.5%, d p 度量概率密度的函数, 较为常见

语义最大误差

是的是康托洛维奇度量 (Kantorovich metric) 和总变异度量 (total variation metric) [32] , 本文为了简化分析, 选择总变

异度量衡量概率分布之间的距离.

5.4 实验结果与分析

● RQ1: 在简洁性和准确性方面, 基于时空价值语义的抽象效果如何?

为了回答 RQ1, 从压缩率 (compression ratio, CR) 和平均绝对误差 (mean absolute error, MAE) 对抽象模型进行