Page 362 - 《软件学报》2025年第7期

P. 362

高梦楠 等: 面向深度学习的后门攻击及防御研究综述 3283

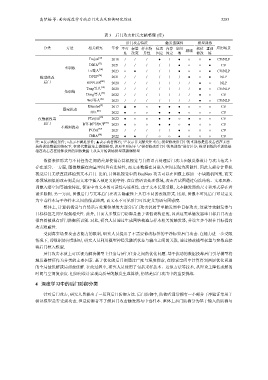

表 3 后门攻击相关文献整理 (续)

后门攻击特征 触发器属性 模型训练

分类 方法 相关研究 年份 不可 标签 样本特 位置 内容 空间 权值 重训 应用场景

见 改变 异性 固定 固定 域 频域 修改 练

[72]

Trojan 2018 / / / ● / ● ○ ○ ● CV/NLP

[73]

DBIA 2021 / / / / / ● ○ ○ ● CV

重训练

Lv等人 [74] 2023 ○ ● / / / ● ○ ○ ● CV/NLP

[76]

模型修改 DFEP 2021 / / / / / / ● ○ ● NLP

后门 RIPPLES [80] 2020 / / / / / / / ● ○ NLP

Tang等人 [78] 2020 / / / / / / / ● ○ CV/NLP

免训练 [79]

Hong等人 2022 / / / / / / / ● ○ CV

Wei等人 [81] 2023 / / / / / / / ● ○ CV/NLP

[2]

Blended 2017 ▲ ● ○ ● ● ● ○ ○ ○ CV

图案扰动

SSL [86] 2022 ● ○ ○ ● ● ● ○ ○ ○ CV

仅数据投毒 FTrojan [88] 2022 ● ○ ○ ● ● ○ ● ○ ○ CV

后门 BTI-DFT/DCT [87] 2023 ● ○ ○ ● ● ○ ● ○ ○ CV

不规则扰动 [89]

PCBA 2021 / / / / / ● ○ ○ ○ CV

IRBA [90] 2022 ● ● / ○ ○ ● ○ ○ ○ CV

注: ●表示满足条件; ○表示不满足条件; ▲表示两者都有; “/”表示非文献关注重点; 模型修改后门中的重训练是指攻击者在无法

获得训练数据的情况下, 在替代数据集上微调模型, 该项主要用于与“模型修改后门中的免训练”进行区分; 模型训练的重训练是

指在攻击者在能够获得的训练数据上从头开始训练模型或微调模型

数据表征形式与不同任务之间的差异使得计算机视觉与自然语言处理后门攻击在触发器设计与攻击范式上

存在差异. 一方面, 图像数据在向量空间具有连续性, 而文本数据在词嵌入空间表现为离散性. 因此大部分计算机

视觉后门无法直接移植到文本后门. 比如, 计算机视觉中的 BadNets 攻击可以在图像上添加一小块随机图案, 而文

本领域相似的攻击则是向文本中插入预定义的字符. 在自然语言处理领域, 攻击者试图通过句法结构、文本风格、

词嵌入潜空间等抽象特征, 保证中毒文本的可读性与连贯性. 由于文本长度受限, 文本触发器的尺寸和形式存在着

诸多限制. 另一方面, 图像后门与文本后门在攻击隐蔽性上具有不同的表现形式. 比如, 图像不可见后门可以定义

为中毒样本与干净样本之间的像素距离, 而文本不可见后门可以定义为语句困惑度.

整体上, 计算机视觉与自然语言处理领域的大部分后门攻击仍属于单触发器单目标攻击, 这就导致触发器与

目标标签之间呈现强相关性. 此外, 目前大多数后门防御是基于该假设构建的, 因此这类单触发器单目标后门攻击

很容易被现有后门防御所识别. 对此, 研究人员通过生成网络构造与样本相关的触发器, 并设立多个潜在目标提高

攻击隐蔽性.

受到真实场景攻击者能力的限制, 研究人员提出了不需要修改标签的干净标签后门攻击. 在能力进一步受限

情况下, 即数据访问受限时, 研究人员利用模型神经元激活状态与输出之间的关联, 通过修改模型权重与参数直接

将后门植入模型.

后门攻击本质上可以视为解决模型主任务与后门任务之间的优化问题. 基于扰动的数据投毒后门引导模型将

触发器特征作为分类的主要因素. 基于优化的后门则通过广度与深度搜索, 在搜索空间中计算得到两层优化问题

的全局最优解或局部最优解. 在此过程中, 研究人员使用了包括采样技术、近似方法等技术, 从理论上降低求解的

时间与空间复杂度. 但如何设计实现高质量的触发生成算法, 仍然是后门攻击中的重要挑战.

4 深度学习中的后门防御分类

针对后门攻击, 研究人员提出了一系列后门防御方法. 后门防御中, 防御者通常拥有一小部分干净验证集用于

验证模型是否受到攻击, 但是防御者不了解后门攻击触发器与中毒样本. 整体上后门防御分为基于输入的防御与