Page 185 - 《软件学报》2024年第6期

P. 185

谢瑞麟 等: IATG: 基于解释分析的自动驾驶软件测试方法 2761

RQ3: 与其他测试数据生成方法相比, IATG 生成测试数据的误导能力和 LPIPS 值如何?

不同的参数设置将影响 IATG 生成测试数据的质量, 为此设计了 RQ1 用以讨论实验参数的设置. 其中, LPIPS

为用于评价测试数据与原始测试数据的相似程度的指标. 为验证 IATG 的有效性, 设计了 RQ2 和 RQ3 以验证和

评价 IATG 的有效性和所生成的测试数据的质量.

3.2 构建替换物体库

实验使用 Cityscapes [14] 和 BDD100K [15] 两个数据集分别使用基于真实图像和基于图像翻译两种策略构建替换

物体库.

3.2.1 基于真实图像构建替换物体库

Cityscapes [14] 、BDD100K [15] 等公开的大型自动驾驶数据集都提供了精细的语义分割标签, 详细标注了图像中

不同物体以及背景的精细轮廓和语义类型. IATG 可使用语义分割标签将不同语义的物体从图像中提取出来. 被

提取的物体应该具有基本的辨识度和完整性以保证语义一致性, 因此只保留像素大于 50×50, 并且不被其他物体

遮挡或截断的物体. 对于从真实图像中提取物体的策略, 使用了 BDD100K [15] 数据集作为提供真实图像的数据集,

其中包含 10 万段高清视频, 每个视频约有 1 200 帧. 对每个视频第 10 秒的关键帧进行采样, 得到 10 万张图片 (图

BDD100K

片尺寸: 1280×720), 并进行详细的语义分割标注, 利用标签将不同语义的物体从原始图像中分离即可获取来自真

实图像的物体.

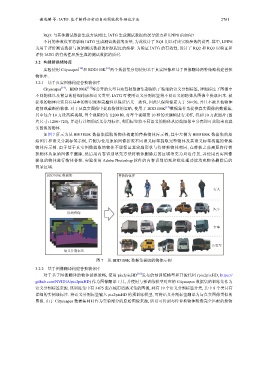

如图 7 所示为从 BDD100K 数据集提取的物体构建的替换物体库示例, 其中左侧为 BDD100K 数据集的原

始图片和语义分割标签示例, 右侧为使用原始图像按照不同语义标签提取完整物体及其语义标签构建的替换

物体库示例. 由于基于真实图像提取的物体不能保证其轮廓形状与待替换物体相同, 在替换之前需要将待替

换物体从原始图像中删除, 然后用内容识别填充方法将物体删除后的区域填充为周边背景, 并使用真实图像

提取的物体进行物体替换. 实验使用 Adobe Photoshop 软件的内容识别填充和批处理功能填充物体删除后的

背景区域.

BDD100K 数据集 替换物体库

行人

汽车

原始图像

卡车

公交车

语义分割标签

图 7 从 数据集提取的物体示例

3.2.2 基于图像翻译构建替换物体库

对于基于图像翻译的物体替换策略, 使用 pix2pixHD [30] 发布的预训练模型和开源代码 (pix2pixHD, https://

github.com/NVIDIA/pix2pixHD) 作为图像翻译工具, 并使用与预训练模型对应的 Cityscapes 数据集的训练集作为

语义分割标签来源. 该训练集中有 3 475 张在城市道路采集的图像, 共有 19 个语义分割标签分类, 其中 8 个类具有

详细的实例级标注. 将语义分割标签输入 pix2pixHD 的预训练模型, 可将语义分割标签翻译为与真实图像类似的

图像. 由于 Cityscapes 数据集同时作为实验部分的原始图像来源, 所以可得到与待替换物体轮廓完全匹配的新物