Page 183 - 《软件学报》2021年第9期

P. 183

杨博 等:一种协同过滤式零次学习方法 2807

g(⋅)更新后的标签语义特征向量 g(c k )记作 q k ,S 为已知类别集合;y i,k 为指示变量,表示样本 x i 是否属于类别 k.p i

与 q k 相乘表示样本 x i 属于已知类别 k 的预测概率.

目标函数的第 2 部分 L c 为图结构约束正则项.通过加入图的结构信息,防止语义知识表示后类间语义关联

发生改变.原始语义空间中类别特征及类间语义关联对语义知识表示过程起重要作用,控制着图中节点间信息

交互的强弱,是度量已知类别和新类别之间关系的重要参考项.所以,为了保持原始的类别间拓扑结构,防止两

个类别在表示学习过程中的语义关联产生变化,在目标函数中加入额外的图结构约束正则项,如公式(7)所示:

su∪

||=

L = || sim − sim 2 ∑∑ su∪ || sim ( , )c c − sim ( ( ), ( )) ||g c g c (7)

c 1 i= 1 j= 1 i j i j 2

其中,sim 1 表示原始语义空间中类别间的语义相似度;sim 2 表示经第 3.2 节语义知识表示过程后,类别在高维特征

空间中的语义相似度;c i ,c j 分别表示两个类别节点的初始语义特征;g(c i ),g(c j )分别表示经第 3.2 节语义知识表示

过程中,图卷积神经网络 g(⋅)更新后的节点特征表示.sim(⋅,⋅)的计算同第 3.2 节中类别语义相关系数 a i,j 的计算过

程.差值越小,越能表示在映射后空间中对应类别仍能维持原始空间中的类别语义关系.

零次学习的推断过程分为两部分完成:首先,使用训练好的图卷积神经网络 g(⋅)对语义图进行更新,将所有

新类别的语义特征 c k 转换为对应的高维特征向量 q k ,k∈N,N 为新类别集合;然后,使用卷积神经网络 f(⋅)为每个测

u

试样本 x 提取视觉特征 p i ,i∈N u (在广义零次学习任务中,i∈N u ∪N s ).将 p i 与各个新类别语义特征 q k 做点积,预测

i

其所属概率,取最大值位置作为最终分类,见公式(8):

p *q

*

y = argmax k u i k (8)

i

∈

|| p i || *|| q k || 2

2

4 实验比较

为了评估本文提出方法的有效性,分别在传统零次学习任务和广义零次学习任务上进行实验,并就任务中

的各项性能与其他基准方法进行比较.实验结果表明:本文提出的协同过滤式零次学习(CF-ZSL)方法可以在较

短的训练时间内普遍提高各任务的分类准确率,能够在不同难度的任务下维持稳定且优异的效果.

4.1 实验数据集和实验设置

以下是本文选用的实验数据集.

• SUN [34] :细粒度场景图像数据集;

• CUB-200-2011 Birds(CUB) [35] :细粒度鸟类图像数据集;

• Animals with Attributes 2(AWA2) [18] :粗粒度动物图像数据集.

表 1 展示了各数据集的统计特征.其中,各数据集除提供图像样本之外,额外提供类别级的属性特征,属性个

数见表 1 中属性维度.这些属性由人工标注,标注标准是对于给定的类别,此属性出现的次数百分比.以 AWA2 数

据集为例,属性特征囊括了对颜色、条纹以及毛发等的特征描述,是区分不同类别的重要的考量因素.所有数据

集均根据零次学习任务的标准划分准则 PS 进行训练集和测试集的划分(PS 划分:负责图像特征抽取的深度卷

积网络作为零次学习模型的一部分,通常使用 ImageNet 图像数据集 [36] 进行预训练,为了保证实验的公平性,经

PS 划分后的测试集类别均不出现在 ImageNet 数据集之中).

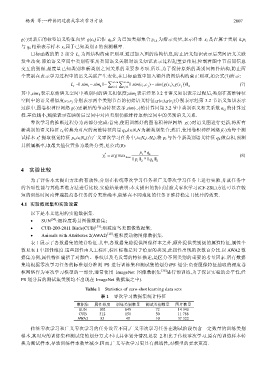

Table 1 Statistics of zero-shot learning data sets

表 1 零次学习数据集统计特征

数据集 属性维度 训练类别数量 测试类别数量 图片数量

SUN 102 645 72 14 340

CUB 312 150 50 11 788

AWA2 85 40 10 37 322

传统零次学习和广义零次学习的任务设置不同,广义零次学习任务在测试阶段包含一定数量的训练类别

样本,其对应的训练集和测试集的划分方式不同,具体划分情况见表 2.相比于传统零次学习,原有的训练样本转

换为测试样本,导致训练样本数量减少.因而,广义零次学习更具有挑战性,对模型的要求更高.