Page 57 - 《软件学报》2020年第10期

P. 57

李鼎基 等:基于跨虚拟机零下陷通信的加速器虚拟化框架 3033

环网络层:循环网络层(下称 RNN)和长短期记忆网络层(下称 LSTM);(3) 深度神经网络中常用的规范化

(normalization)网络层:批规范化网络层(下称 BN);(4) 深度神经网络中常用的激活(activation)网络层:各类激活

函数网络层,包含 ReLU、Sigmoid、TanH 等常见激活函数,统称为神经元网络层(下称 Neuron).

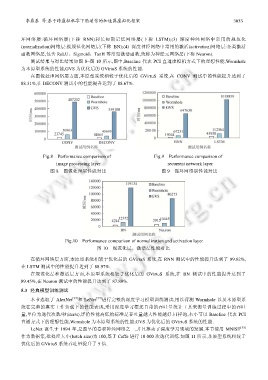

测试结果与对比结果如图 8~图 10 所示,图中,Baseline 代表 PCI 直通虚拟机方式下的理想性能,Wormhole

为本原型系统的性能,GVS 为优化后的 GVirtuS 系统的性能.

在图像处理网络层方面,本原型系统相较于优化后的 GVirtuS 系统,在 CONV 测试中的性能提升达到了

88.31%,在 DECONV 测试中的性能提升达到了 88.67%.

Fig.8 Performance comparison of Fig.9 Performance comparison of

image processing layer recurrent network layer

图 8 图像处理层性能对比 图 9 循环网络层性能对比

Fig.10 Performance comparison of normalization and activation layer

图 10 规范化层、激活层性能对比

在循环网络层方面,本原型系统相较于优化后的 GVirtuS 系统,在 RNN 测试中的性能提升达到了 89.62%,

在 LSTM 测试中的性能提升达到了 88.97%.

在规范化层和激活层方面,本原型系统相较于优化后的 GVirtuS 系统,在 BN 测试中的性能提升达到了

89.45%,在 Neuron 测试中的性能提升达到了 87.89%.

5.3 经典模型训练测试

本节选取了 AlexNet [33] 和 LeNet [34] 进行完整的深度学习模型训练测试,用以评测 Wormhole 以及本原型系

统在完整的真实工作负载下的性能表现,采用深度学习框架自带的吞吐量统计工具来衡量训练过程中的吞吐

量,单位为迭代次数/秒(iter/s),评价性能高低的标准是吞吐量越大性能越好.同样地,本小节以 Baseline 代表 PCI

直通方式下的理想性能,Wormhole 为本原型系统的性能,GVS 为优化后的 GVirtuS 系统的性能.

LeNet 诞生于 1994 年,是最早的卷积神经网络之一,并且推动了深度学习领域的发展.本节使用 MNIST [35]

作为数据集,批处理大小(batch size)为 100,基于 Caffe 进行 10 000 次迭代训练.如图 11 所示,本原型系统相较于

优化后的 GVirtuS 系统吞吐量提升了 5 倍.